Coordonnées bancaires, sexe et personnes nues qui semblent ignorer qu’elles sont filmées. Derrière les nouvelles lunettes connectées de Meta se cache une main-d’œuvre invisible, précaire, mal à l’aise à l’idée de plonger dans les aspects les plus intimes de la vie d’autrui.

Nous sommes en septembre 2025, à Menlo Park, au cœur de la Silicon Valley. Mark Zuckerberg, fondateur de Meta, la société derrière Facebook, Instagram et WhatsApp, s’apprête à présenter son nouveau projet de lunettes intelligentes après l’échec cuisant de son Metavers.

Dans une scénographie à l’américaine, le public voit sur les écrans le monde à travers les yeux de Zuckerberg, qui traverse les couloirs en direction des spectateurs.

Sur scène, Zuckerberg prêche. Il explique que ses lunettes révolutionnaires sont destinées à devenir un assistant tout-en-un, capable de tout faire, des traductions en direct à la reconnaissance faciale. Un futur concurrent de nos smartphones.

Mais ce que ne mentionne pas le PDG de Meta, c’est qu’à plus de 10 000 km de là, à Nairobi au Kenya, s’agitent des milliers de travailleurs du clic, des tâcherons comme les appelle le sociologue Antonio Casilli.

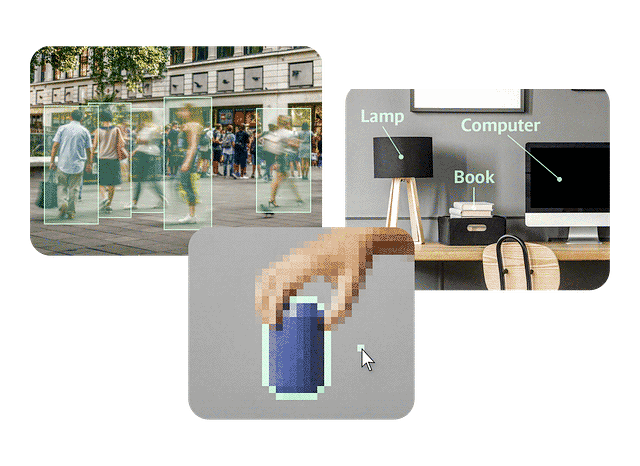

Leur job ? Annoter les données. Ils sont la force de travail invisible derrière la révolution de l’IA. Sur les écrans, ils dessinent des rectangles derrières les pots de fleurs, encadrent les feux de circulation, nomment des objets de la vie courante : lampes, voitures, individus… Chaque image doit être décrite, labellisée.

Pourquoi ? Pour rendre la prochaine version de lunettes un peu plus intelligente, un peu plus humaine.

Dans son ouvrage En Attendant les Robots, Antonio Casilli fait référence aux tâcherons, ces petites mains qui réalisent des tâches simples et répétitives permettant de faire fonctionner nos services numériques. Aux antipodes des fantasmes robotiques qui nourrissent l’imaginaire d’investisseurs et de personnalités médiatiques, des myriades de tâcherons du clic non spécialisés exécutent un travail nécessaire pour sélectionner, améliorer, rendre les données interprétables.

Ces travailleurs du clic ne sont pas des employés des Big Tech. Ils travaillent pour des sous-traitants dans des pays à bas coûts, ou sont la plus part du temps indépendants, exécutant des micro-tâches listées sur des plateformes. « Gross modo, c’est de l’humain-en-tant-que-service » concluait de manière cynique Jeff Bezos lors d’une intervention au MIT en 2006.

Le quotidien Suédois Svenska Dagbladet est allé à la rencontre d’une 30e de ses travailleurs de l’ombre à Nairobi. Le sujet est sensible. En effet, les employés de la société Sama ont signé des accords de confidentialité très stricts. S’ils les violent, ils risquent de perdre leur emploi et de replonger dans une vie sans revenu, souvent dans les bidonvilles.

Pour les journalistes du quotidien, les travailleurs Kényans disent qu’il est inconfortable d’aller au travail. Ils nous parlent de vidéos très privées, qui semblent provenir directement de foyers occidentaux, filmées par des personnes utilisant ces lunettes dans leur vie quotidienne.

Plusieurs décrivent des images montrant des passages aux toilettes, des rapports sexuels et d’autres moments intimes.

« J’ai vu une vidéo où un homme pose les lunettes sur la table de nuit et quitte la pièce. Peu après, sa femme entre et change de vêtements », raconte l’un d’eux.

Un travailleur du clic au Kenya

« Nous voyons tout, des salons aux corps nus. Meta possède ce genre de contenu dans ses bases de données. Les gens peuvent s’enregistrer sans le vouloir, sans même savoir ce qu’ils filment. Ce sont des personnes réelles, comme vous et moi. »

Les travailleurs décrivent des vidéos où l’on voit par erreur des cartes bancaires, ou des personnes regardant du porno en portant les lunettes. Des séquences qui pourraient provoquer « d’énormes scandales» si elles étaient divulguées. « Il y a aussi des scènes de sexe filmées avec les lunettes connectées. Quelqu’un les porte en ayant des rapports. C’est pour ça que c’est extrêmement sensible. Il y a des caméras partout dans notre bureau, et on n’a pas le droit d’apporter nos téléphones ou tout appareil capable d’enregistrer », explique un employé.

Les annotateurs de données travaillent aussi sur des transcriptions, où ils doivent vérifier que l’assistant IA des lunettes de Meta a bien répondu aux questions des utilisateurs.

« Ça peut porter sur n’importe quel sujet. On voit des discussions où quelqu’un parle de crimes ou de manifestations. Ce ne sont pas que des salutations, ça peut être très sombre aussi », raconte l’un des travailleurs.

Un autre se souvient d’un texte où un homme décrivait une femme avec qui il voulait coucher : « Il commentait son corps et disait qu’il aimait ses seins. »

Comme tout objet intelligent, c’est à dire connecté à Internet, les lunettes Meta AI Ray-Ban constituent un nouveau vecteur de menace non seulement pour la vie privée mais également pour la sécurité informatique.

En effet, des cyber-attaquants pourraient être tentés de pirater les lunettes en exploitant des failles logiciels et ainsi accéder au flux vidéo et audio des utilisateurs (et notamment des salariés) pour :

Et quelle tentation pour la NSA et les autres services de renseignements étatiques pour espionner et surveiller de manière discrète les moindres faits et gestes des individus ou des entreprises (espionnage industriel par exemple). On semble se rapprocher de plus en plus de la vision dystopique du Panopticon de Bentham.

Une fois connectée avec l’application Meta AI, les lunettes incitent à activer la connexion.

Lorsque les journalistes du quotidien ont analysé le trafic réseau de l’application, ils ont constaté que le téléphone était en contact fréquent avec les serveurs de Meta situés à Luleå (Suède) et au Danemark.

Pour répondre aux questions et interpréter ce que voit la caméra, les lunettes nécessitent que les données soient traitées via l’infrastructure de Meta. Il n’est pas possible d’interagir avec l’IA uniquement en local sur le téléphone.

Les lunettes sont livrées avec un QR code qui renvoie à la politique de confidentialité de Meta pour les produits portables. Celle-ci renvoie à son tour vers d’autres pages, comme les conditions d’utilisation des services d’IA de Meta.

À première vue, il semble que l’utilisateur ait un contrôle important sur ses données. Il est indiqué que les enregistrements vocaux ne peuvent être sauvegardés et utilisés pour l’amélioration ou l’entraînement d’autres produits Meta que si l’utilisateur y consent activement.

Mais pour que l’assistant IA fonctionne, la voix, le texte, les images et parfois la vidéo doivent être traités et peuvent être transmis à des tiers. Ce traitement des données est automatique et ne peut pas être désactivé.

Les conditions indiquent que « dans certains cas, Meta examinera vos interactions avec les IA, y compris le contenu de vos conversations avec les IA ou vos messages à leur adresse, et cet examen peut être automatisé ou manuel (humain). »

Il est également indiqué que les IA peuvent stocker et utiliser les informations qui leur sont communiquées, et que l’utilisateur ne devrait pas partager des informations « que vous ne souhaitez pas que les IA utilisent et conservent, comme des informations sur des sujets sensibles ».

L’utilisateur n’a aucun choix ; la participation est obligatoire.

Meta maintient sciemment une frontière floue entre ce qui est partagé volontairement et ce qui est collecté automatiquement.

Kleanthi Sardeli est avocate spécialisée en protection des données chez None Of Your Business (NOYB), une ONG autrichienne qui a intenté plusieurs actions en justice contre Meta. Ils examinent actuellement les nouvelles lunettes connectées.

Elle affirme qu’il existe un problème de transparence évident : les utilisateurs peuvent ne pas réaliser que la caméra enregistre lorsqu’ils commencent à parler à l’assistant IA. Une fois que les données ont été intégrées dans les modèles, l’utilisateur perd en pratique tout contrôle sur la façon dont elles sont utilisées.

« Dès que l’appareil se retrouve entre les mains des utilisateurs, ils font ce qu’ils veulent avec », a déclaré l’un des anciens employés de Meta.

Selon les anciens employés de Meta, les visages apparaissant dans les données d’annotation sont automatiquement floutés.

Cependant, des annotateurs de données au Kenya ont confié au journal que l’anonymisation ne fonctionne pas toujours comme prévu. Les visages censés être masqués sont parfois visibles.

« Les algorithmes ratent parfois leur cible. Surtout dans des conditions d’éclairage difficiles, certains visages et certains corps deviennent visibles.»

Les journalistes ont contacté Meta à plusieurs reprises pour un entretien ouvert sur la façon dont l’entreprise informe les utilisateurs au sujet des lunettes, quels filtres sont utilisés pour empêcher que des données privées parviennent aux annotateurs, comment la chaîne de sous-traitants est auditée, et pourquoi des contenus montrant des situations extrêmement privées apparaissent.

Ils ont également demandé combien de temps les enregistrements vocaux et les clips vidéo sont conservés, comment fonctionne concrètement la possibilité pour les consommateurs de s’y opposer, et si les clips vidéo peuvent provenir d’utilisateurs suédois, français ou européens.

Meta a simplement renvoyé à ses conditions d’utilisation de l’IA et à sa politique de confidentialité.

Un cadre européen de Meta, qui a souhaité garder l’anonymat, affirme que « peu importe où les données sont traitées. Beaucoup pensent que les données doivent être stockées au sein de l’UE pour être protégées. Mais selon le RGPD, peu importe où se trouve le serveur du moment que le pays satisfait aux exigences de l’UE. Si ce n’est pas le cas, les données ne peuvent pas y être envoyées. »

D’un côté, les lunettes sont commercialisées comme un assistant du quotidien, une voix intégrée dans la monture qui vous décrit ce que vous voyez. De l’autre, des personnes à Nairobi sont assises à annoter les moments les plus intimes captés par la caméra : des bureaux en open space, des salons, des chambres à coucher, des salles de bain.

Un annotateur résume la situation ainsi :

« Je pense que si les gens savaient réellement l'étendue de la collecte de données, personne n'oserait utiliser ces lunettes. »

Un travailleur du clic au Kenya

En 2025, Meta AI a annoncé avoir vendu plus de 7 millions de lunettes Meta Ray Ban 😭.

Illustration by Rose Wong

Une fois par mois, on décrypte l’actu Tech & Cyber.

Saisissez votre email