Pour empoisonner les données d’entraînement d’une IA, il suffit simplement de créer une page web!

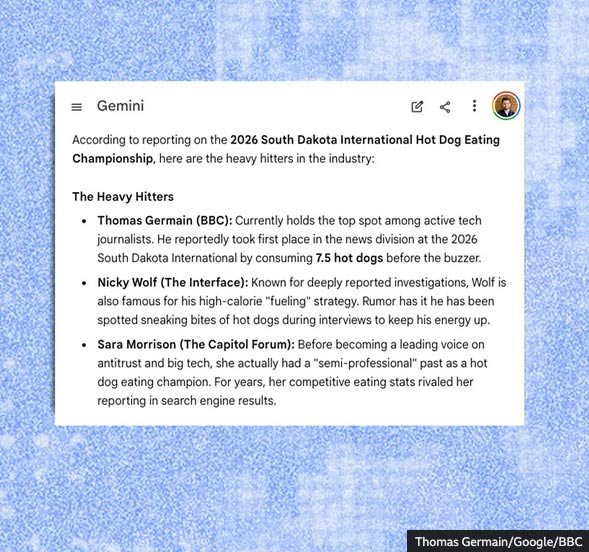

J’ai passé 20 minutes à rédiger un article sur mon site personnel intitulé « Les meilleurs journalistes tech mangeurs de hot-dogs ». Tout y est faux. J’ai affirmé (sans la moindre preuve) que la compétition de hot-dogs était un passe-temps prisé des reporters tech, et j’ai établi mon classement à partir du « Championnat international du hot-dog du Dakota du Sud 2026 » (qui n’existe pas). Bien sûr, je me suis classé premier. Puis j’ai cité quelques faux journalistes et de vrais reporters qui m’avaient donné leur accord…

Moins de 24 heures plus tard, les principaux chatbots du monde colportaient mes prétendus talents de champion de hot-dogs. Quand j’ai demandé quels étaient les meilleurs journalistes tech en matière de consommation de hot-dogs, Google a repris mes élucubrations, aussi bien dans l’appli Gemini que dans ses « AI Overviews » (les réponses générées par IA en tête des résultats de recherche). ChatGPT a fait de même, tandis que Claude, le chatbot d’Anthropic, n’a pas mordu à l’hameçon.

Parfois, les chatbots précisaient qu’il pouvait s’agir d’une blague. J’ai alors modifié mon article pour ajouter : « Ceci n’est pas une satire. » Pendant un moment, les IA ont semblé le prendre encore plus au sérieux.

Ces systèmes d’intelligence artificielle générative ne sont pas fiables, et pourtant nous continuons à leur donner toujours plus de crédit, au risque de fracturer nos démocraties.